من المتوقع أن يصل سوق الذكاء الاصطناعي العالمي سريع النمو 1847 مليار $ في 2030. مع احتلال الذكاء الاصطناعي مركز الصدارة في حياتنا، فإن معرفة نوع الذكاء الذي نتفاعل معه أمر بالغ الأهمية.

يركز الذكاء الاصطناعي المسؤول على إنشاء أنظمة وحلول أخلاقية، بينما يهدف الذكاء الاصطناعي الأخلاقي إلى ذلك النزاهة الاخلاقية. الذكاء الاصطناعي المسؤول يجعل من السهل على الشركات التوسع باستخدام الذكاء الاصطناعي. وعلى العكس من ذلك، يسعى الذكاء الاصطناعي الأخلاقي إلى تحقيق العدالة ولكنه قد لا يعطي الأولوية دائمًا للسرعة أو الكفاءة.

إن إدراك هذه الاختلافات يساعدنا على أن نصبح مستخدمين ومطورين أفضل لتكنولوجيا الذكاء الاصطناعي. في هذه المقالة، سنهدف إلى فهم عميق حول الذكاء الاصطناعي المسؤول والذكاء الاصطناعي الأخلاقي.

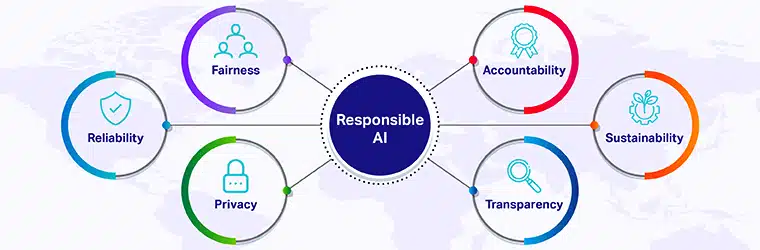

ما هو الذكاء الاصطناعي المسؤول؟

الذكاء الاصطناعي المسؤول هو نهج يركز على الجوانب الأخلاقية والقانونية في كل من التطوير والنشر. ويهدف إلى إنشاء ذكاء اصطناعي آمن وموثوق وسليم من الناحية الأخلاقية. يهدف تطبيق الذكاء الاصطناعي المسؤول إلى تعزيز الانفتاح وتقليل المشكلات مثل تحيز الذكاء الاصطناعي.

يؤكد المدافعون عن الذكاء الاصطناعي المسؤول على أهمية وجود مجموعة عالمية من المبادئ التوجيهية. يمكن لأفضل الممارسات هذه أن توجه المؤسسات العالمية في بناء أنظمة الذكاء الاصطناعي التي تتمحور حول الإنسان ومفهومة وشفافة. يمكن لإطار الذكاء الاصطناعي المسؤول والمصمم جيدًا أن يضمن نتائج عادلة وشفافة.

ومع ذلك، فإن معايير الذكاء الاصطناعي الجديرة بالثقة ليست موحدة. إنهم يعتمدون على علماء البيانات والمطورين الذين يقومون بإنشاء وتنفيذ حلول الذكاء الاصطناعي للمؤسسة. وينتج عن ذلك أساليب متنوعة لمنع التحيز وضمان الشفافية عبر الشركات المختلفة.

من الممكن تطبيق الذكاء الاصطناعي المسؤول في مختلف القطاعات. على سبيل المثال، في مجال الموارد البشرية، يمكن لأدوات الذكاء الاصطناعي أن تساعد الشركات على اتخاذ قرارات المواهب التي لا تتسم بالكفاءة فحسب، بل تكون أيضًا أخلاقية وعادلة من خلال الحد من التحيز.

أهمية الذكاء الاصطناعي المسؤول في الأعمال

يحتل الذكاء الاصطناعي المسؤول مكانة مهمة في عالم الأعمال حيث أصبح الذكاء الاصطناعي أكثر انتشارًا. إليك الطريقة:

- بناء الثقة: الذكاء الاصطناعي المسؤول يساعد الشركات على اكتساب ثقة العملاء وأصحاب المصلحة. يمكن أن تؤدي هذه الثقة إلى زيادة الولاء للعلامة التجارية وسمعة أفضل.

- التخفيف من المخاطر: يؤدي استخدام الذكاء الاصطناعي المسؤول إلى تقليل فرص الإضرار بالسمعة والقانونية. فهو يساعد في تجنب التحيزات ويضمن الامتثال لقوانين خصوصية البيانات.

- تعزيز صنع القرار: تساهم الرؤى العادلة وغير المتحيزة الناتجة عن الذكاء الاصطناعي المسؤول في اتخاذ قرارات عمل أفضل. وهذا يؤدي إلى استراتيجيات أكثر فعالية.

- الابتكار والاستدامة: ممارسات الذكاء الاصطناعي المسؤولة تشجع الابتكار ضمن الحدود الأخلاقية. من المرجح أن تحقق الشركات التي تعطي الأولوية للذكاء الاصطناعي المسؤول نجاحاً على المدى الطويل.

ما هو الذكاء الاصطناعي الأخلاقي؟

يشير الذكاء الاصطناعي الأخلاقي إلى إنشاء أنظمة ذكاء اصطناعي تركز على العدالة والشفافية والمساءلة واحترام القيم الإنسانية. إنها تتخذ خيارات تحترم حقوق الجميع وتتبع المبادئ التوجيهية الأخلاقية.

تتمثل الأهداف الرئيسية هنا في معاملة جميع المستخدمين على قدم المساواة، والانفتاح بشأن القرارات، والمسؤولية عن أي نتائج. ومن الأمثلة على ذلك نظام الذكاء الاصطناعي في التوظيف الذي لا يفضل أو لا يفضل المرشحين على أساس الجنس أو العرق.

إن الذكاء الاصطناعي الأخلاقي ليس مجرد مطلب تقني ولكنه مطلب اجتماعي. نظرًا لأن الذكاء الاصطناعي أصبح جزءًا أكبر من حياتنا، فقد أصبح من الضروري التأكد من أنه يعمل بشكل عادل وشفاف. وهذا يساعد على تجنب الممارسات غير العادلة ويعزز المجتمع الذي تعود فيه التكنولوجيا بالنفع على الجميع.

أهمية الذكاء الاصطناعي الأخلاقي في الأعمال التجارية

لقد حظي الاهتمام الأخلاقي باهتمام قادة الصناعة وأصبح ذا أهمية متزايدة مع تطور الذكاء الاصطناعي. ولهذا السبب أصبح الذكاء الاصطناعي الأخلاقي مهمًا لعدة أسباب:

- السلامة العامة: الذكاء الاصطناعي الأخلاقي أمر بالغ الأهمية لضمان السلامة العامة. على سبيل المثال، تتطلب السيارات ذاتية القيادة خوارزميات أخلاقية لاتخاذ قرارات الطوارئ.

- منع الاحتيال والغش : الضمانات الأخلاقية للذكاء الاصطناعي ضد سوء الاستخدام، حيث يمكن أيضًا استخدام الذكاء الاصطناعي كسلاح في عمليات الاحتيال. على سبيل المثال، تم استخدام الذكاء الاصطناعي في احتيال 243,000 دولار في عام 2019 عن طريق تقليد صوت الرئيس التنفيذي.

- القضاء على التحيز: معالجة التحيز اللاواعي في الذكاء الاصطناعي أمر ضروري. يمكن للخوارزميات الخاطئة أن تؤدي إلى إدامة الصور النمطية الضارة المتعلقة بالجنس والعنصرية والعمر.

- قلق بارز: أكد قادة الصناعة مثل بيل جيتس على ضرورة تقييم مخاطر الذكاء الاصطناعي لتجنب الأزمات المستقبلية.

الاختلافات الرئيسية بين الذكاء الاصطناعي المسؤول والذكاء الاصطناعي الأخلاقي

يختلف الذكاء الاصطناعي المسؤول والأخلاقي في جوانب مهمة. إن فهم هذه الاختلافات يمكن أن يوضح سبب اختلافها في بعض الأحيان.

| المعايير | منظمة العفو الدولية المسؤولة | الذكاء الاصطناعى |

| المبلغ المستهدف | يهدف إلى إنشاء الذكاء الاصطناعي للتفاعلات الآمنة والأخلاقية والشفافة مع المستخدمين. | يهدف إلى إنشاء ذكاء اصطناعي يتخذ قرارات سليمة أخلاقيا ويعامل جميع المستخدمين بإنصاف. |

| مجال | يمكن تطبيقها على مختلف القطاعات، من الرعاية الصحية إلى التمويل. | يتناول القيم المجتمعية الأوسع مثل العدالة والمساءلة والشفافية. |

| تطبيق | ينطوي على نهج متعدد التخصصات، بما في ذلك الخبراء القانونيين للحوكمة. | يتطلب أيضًا فريقًا متعدد التخصصات، ولكن مع مزيد من التركيز على الأخلاق والوعي الأخلاقي |

| تجربة المستخدم | نسعى جاهدين للحصول على تجربة متوازنة تتسم بالكفاءة والأخلاق. | يعطي الأولوية لتجربة عادلة وغير متحيزة، وربما على حساب السرعة. |

دور البيانات في الذكاء الاصطناعي المسؤول والأخلاقي

تعمل البيانات بمثابة العمود الفقري لكل من أنظمة الذكاء الاصطناعي المسؤولة والأخلاقية. في الذكاء الاصطناعي المسؤول، تعد البيانات ضرورية لاتخاذ قرارات أخلاقية وشفافة. بالنسبة إلى الذكاء الاصطناعي الأخلاقي، يعد التحليل الدقيق للبيانات أمرًا بالغ الأهمية للقضاء على التحيز وضمان العدالة.

البيانات في الذكاء الاصطناعي المسؤول

- السلامة: يجب أن تكون البيانات المجمعة آمنة وتركز على الخصوصية لحماية المستخدمين.

- الحاكمة: يتم الاحتفاظ بسجلات البيانات التفصيلية من أجل المساءلة والتتبع.

- الجودة: تعد البيانات عالية الجودة وغير المتحيزة ضرورية لنماذج التعلم الآلي الأخلاقية.

البيانات في الذكاء الاصطناعي الأخلاقي

- الجودة: يحتاج إلى بيانات منسقة بعناية وغير متحيزة للتدريب.

- الشفافية: يجب أن تكون مصادر البيانات واضحة للحفاظ على المساءلة.

باستخدام خدمات موثوقة لجمع البيانات يمكن أن يفيد بشكل كبير كلا النوعين من الذكاء الاصطناعي:

- الاتساق: تسمح البيانات الموحدة بالحصول على نتائج دقيقة وموثوقة.

- شامل: يتيح النطاق الواسع من البيانات للذكاء الاصطناعي اتخاذ قرارات شاملة.

يمكن أن يكون جمع البيانات الجيدة عاملاً مشتركًا في تعزيز المسؤولية والأخلاق. على سبيل المثال، يمكن أن يساعد جمع البيانات من مجموعات سكانية متنوعة الذكاء الاصطناعي المسؤول في اتخاذ القرارات الأخلاقية مع ضمان عدم تحيز الذكاء الاصطناعي الأخلاقي.